WnioskowanieStatystyczne/Bonferroni

Wnioskowanie_Statystyczne_-_wykład

Spis treści

Błędy I i II rodzaju

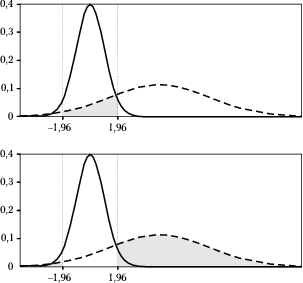

Przyjęcie poziomu istotności ([math]\alpha[/math]) na poziomie 5 procent oznacza, że średnio w jednym na dwadzieścia przypadków możemy odrzucić prawdziwą hipotezę, czyli popełnić błąd I rodzaju (false positive).

Dla kompletności przypomnijmy, że błąd II rodzaju polega na przyjęciu hipotezy fałszywej (false negative) i jest związany z poziomem istotności testu.

Pojęcia błędów I i II rodzaju, podobnie jak hipotezy zerowej (H0) wprowadzili do statystyki Jerzy Spława-Neyman i Egon Pearson w latach 30. XX wieku.

| hipoteza H0 | |||

| Prawdziwa | Fałszywa | ||

|---|---|---|---|

| decyzja | Odrzuć | błąd typu I (False Positive) | poprawna (True Positive) |

| Przyjmij | poprawna (True Negative) | błąd typu II (False Negative) | |

Krzywa ROC (receiver operating characteristic)

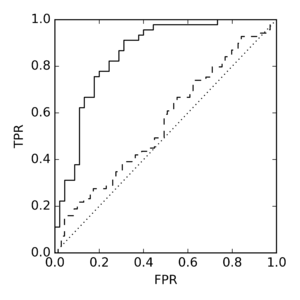

Opisane powyżej błędy odnoszą się do ostatecznych, binarnych decyzji systemu (np. przynależność do grupy A lub B). Jednak bardzo często system na "przedostatnim" stadium zwraca wielkość odpowiadającą prawdopodobieństwu przynależności do jednej z grup. Dopiero wybranie progu daje nam decyzję binarną. Ten próg możemy dobierać w zależności od tego, czy ważniejsze jest unikanie FP czy maksymalizowanie TP.

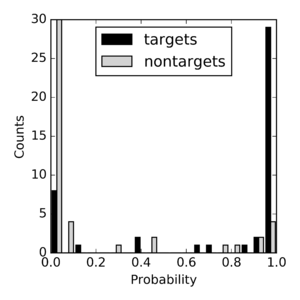

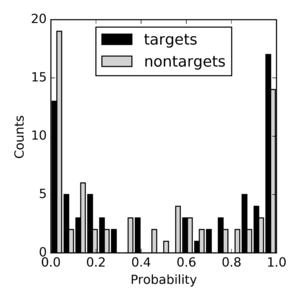

Na poniższych ilustracjach Rys. 2 i Rys. 3 z artykułu dostępnego w Internecie przedstawiono histogramy decyzji klasyfikatora, który przypisywał odcinkom EEG prawdopodobieństwo faktu, że wystąpił w nim potencjał wywołany, który związany jest z koncentracją uwagi na bodźcu wyświetlanym w danym momencie. Jako "ground truth", czyli kryterium, przyjęto deklarowane przez użytkowników intencje zwracania uwagi na dany bodziec (target) lub nie (nontarget).

AUC (inaczej AUROC, czyli Area Under ROC) to pole pod krzywą ROC, określające jakość separacji rozkładów dla różnych ustawień progu.

Wielokrotne porównania

Problem wielokrotnych porównań (ang. multiple comparisons) pojawia się w eksploracyjnej (w odróżnieniu od konfirmacyjnej) analizie danych, por. np. http://en.wikipedia.org/wiki/Data_dredging zwane też p-hacking.

Przykład

[math]N[/math] obserwacji podzielonych na 7 grup. Testujemy hipotezę o różnicy między średnimi dowolnych par grup, wykonując [math]\binom{7}{2}=21[/math] testów różnic między dwoma grupami.

Załóżmy, że podziału na 7 grup dokonaliśmy zupełnie przypadkowo, czyli że nie powinna wystąpić istotna statystycznie różnica między średnimi żadnej pary. Jeśli test dla każdej pary wykonujemy na poziomie istoności p=5%, to przyjmujemy, że z prawdopodobieństwem 0,05 test może wykazać różnicę (FP). Prawdopodobieństwo, że test nie wykaże różnicy, wynosi[1] 1 - 0,05 = 0,95. Prawdopodobieństwo, że test poprawnie nie wykaże różnicy we wszystkich 21 porównaniach, wynosi (0,95)21 czyli ok. 0,34. Tak więc prawdopodobieństwo, że przynajmniej w jednej parze grup test fałszywie wykaże różnicę, pomimo wykonywania każdego testu na poziomie istotności 0,05 wynosi aż 1 - 0,34 = 0,66!

FWER: family-wise error rate

Poziom istotności zdefiniowany dla pojedynczych testów zastępujemy pojęciem FWER, czyli prawdopodobieństwem popełnienia przynajmniej jednego błędu I rodzaju w grupie (rodzinie) testów.

Poprawka Bonferroniego

gwarantuje, że jeśli każdy z m testów wykonamy na poziomie istotności [math]\frac{\alpha}{m}[/math], to [math]\mathrm{FWER}=\alpha[/math].

Rozważmy rodzinę m hipotez Hi (w powyższym przykładzie m = 21), przypisując każdej Hi p-wartość (ang. p-value) pi. Niech m0 z tych hipotez będzie prawdziwych. FWER, czyli prawdopodobieństwo popełnienia przynajmniej jednego błędu I rodzaju w którymś z m testów hipotez Hi, będzie nie większy niż suma prawdopodobieństw popełnienia błędu I rodzaju [math] P\left(p_i\leq\frac \alpha m\right)[/math] w każdym testów z osobna. I to niezależnie od tego, czy testy są niezależne czy nie, ani od wartości m0, czyli od tego jak wiele z hipotez Hi jest prawdziwych:

[math] \text{FWER} = P\left\{ \bigcup_{i=1}^{m_0}\left(p_i\leq\frac \alpha m \right) \right\} \leq \sum_{i=1}^{m_0} P\left(p_i\leq\frac \alpha m\right) \leq m_0 \frac{\alpha}{m} \leq m \frac{\alpha}{m} = \alpha.[/math]

-- skorzystaliśmy z nierówności Boole'a. Jak widać jest to poprawka bardzo konserwatywna, wymuszająca przeprowadzanie testów na potencjalnie zaniżonych poziomach istotności [math]\frac{\alpha}{m}[/math].

Sprawdźmy jak zadziała w przykładzie 7 grup: mamy 21 porównań, jeśli chcemy utrzymać prawdopodobieństwo co najmniej jednego błędu I rodzaju na poziomie 5%, każdy test musimy wykonać na poziomie 0,05 / 21 = ok. 0.002381, czyli mniej niż 0,0024%! Wtedy prawdopodobieństwo popełnienia jednego błędu I rodzaju wyniesie

[math] 1 - \left( 1 - \frac{0,05}{21} \right)^{21} \approx 0,0488 [/math]

czyli mniej niż 0,05.

Analogiczny wynik dostaniemy np. dla tysiąca testów

[math] 1 - \left( 1 - \frac{0,05}{1000} \right)^{1000} \approx 0,0488 [/math]

ale wtedy każdy z testów musielibyśmy wykonywać na poziomie istotności 0,00005.

Poprawka Bonferroniego-Holma

P-wartości pi odpowiadające hipotezom Hi sortujemy w kolejności od najmniejszej do największej

p(1) < p(2) < ... < p(m)

Dla [math]\textrm{FWER}=\alpha[/math] znajdujemy najmniejsze k, dla którego

[math]p_k \gt \frac{\alpha}{m+1-k}[/math]

i odrzucamy hipotezy H1 ... Hk-1, przyjmując Hk ... Hm.

dowód

Załóżmy, że wśród m testowanych Hi jest m0 hipotez prawdziwych.

Musimy dowieść, że prawdopodobieństwo popełnienia błędu I rodzaju w tej procedurze jest nie większe niż [math]\alpha[/math].

Zaczynamy od H1: niech pierwszą prawdziwą odrzuconą hipotezą (pierwszy błąd I rodzaju, false positive) będzie Hk. To znaczy, że Hk-1 była ostatnią hipotezą fałszywą, i

- [math]k - 1 + m_0 \leq m \implies m_0 \leq m - k + 1[/math].

Skoro Hk została odrzucona, to z definicji procedury

- [math] p_k \leq \frac{\alpha}{m - k +1} \leq \frac{\alpha}{m_0}[/math]

bo skoro [math]m_0 \leq m - k + 1[/math], to [math]\frac{\alpha}{m - k +1} \leq \frac{\alpha}{m_0}[/math]. Odpowiada to poprawce Bonferroniego w zbiorze m0 hipotez prawdziwych.

False Discovery Rate FDR

...w podobnej procedurze kontroluje oczekiwany stosunek liczby hipotez błędnie odrzuconych do liczby hipotez odrzuconych. Poniżej przykład zastosowania z artykułu On the statistical significance of event-related EEG desynchronization and synchronization in the time-frequency plane. PDF.

Evaluation of measurement data — Guide to the expression of uncertainty in measurement

JCGM 100:2008 GUM 1995 with minor corrections http://www.iso.org/sites/JCGM/GUM-JCGM100.htm

3.4.8 Although this Guide provides a framework for assessing uncertainty, it cannot substitute for critical thinking, intellectual honesty and professional skill. The evaluation of uncertainty is neither a routine task nor a purely mathematical one; it depends on detailed knowledge of the nature of the measurand and of the measurement. The quality and utility of the uncertainty quoted for the result of a measurement therefore ultimately depend on the understanding, critical analysis, and integrity of those who contribute to the assignment of its value.

- ↑ dla testów niezależnych; w tym przykładzie wyniki testów nie będą niezależne -- dlaczego?