WnioskowanieStatystyczne/Analiza wariancji: Różnice pomiędzy wersjami

| (Nie pokazano 12 pośrednich wersji utworzonych przez tego samego użytkownika) | |||

| Linia 14: | Linia 14: | ||

posiada rozkład <math>F</math> z <math>f_{1}</math> i | posiada rozkład <math>F</math> z <math>f_{1}</math> i | ||

| − | <math>f_{2}</math> stopniami swobody | + | <math>f_{2}</math> stopniami swobody o wartości oczekiwanej <math>E(f)=\frac{f_{2}}{(f_{2}-2)}</math> |

<math> | <math> | ||

| Linia 43: | Linia 43: | ||

<math>f_{x}</math> stopniach swobody. | <math>f_{x}</math> stopniach swobody. | ||

| − | == | + | ==Analiza wariancji ''(ANalysis of VAriance — ANOVA)''== |

| − | |||

| − | |||

| − | + | <math>N</math> obserwacji <math>\{x_{i}\}_{i=1..N}</math> | |

| − | + | [[Plik:Anova1.png|500px]] | |

| + | podzielonych na <math>k</math> grup wedle jakiegoś kryterium: | ||

| + | <math>N=n_{1}+n_{2}+...+n_{k}</math>. | ||

| − | + | [[Plik:Anova2.png|500px]] | |

| − | |||

| − | |||

| − | + | Średnie wewnątrz grup | |

| − | |||

| − | |||

<math> | <math> | ||

\overline{x}_{i}=\frac{1}{n_{i}}\underset{j=1}{\overset{n_{i}}{\sum }}x_{ij} | \overline{x}_{i}=\frac{1}{n_{i}}\underset{j=1}{\overset{n_{i}}{\sum }}x_{ij} | ||

</math> | </math> | ||

| + | |||

| + | [[Plik:Anova3.png|500px]] | ||

| + | |||

| + | Średnia globalna <math>\overline{x}</math> | ||

| + | |||

| + | [[Plik:Anova4.png|500px]] | ||

Rozważmy sumę kwadratów odchyleń wszystkich elementów próby od | Rozważmy sumę kwadratów odchyleń wszystkich elementów próby od | ||

wartości średniej całej próby: | wartości średniej całej próby: | ||

| + | |||

| + | [[Plik:Anova5.png|500px]] | ||

| + | |||

<math>\begin{matrix} | <math>\begin{matrix} | ||

| Linia 78: | Linia 83: | ||

_{i})(\overline{x}_{i}-\overline{x}) | _{i})(\overline{x}_{i}-\overline{x}) | ||

\end{matrix}</math> | \end{matrix}</math> | ||

| + | |||

| + | |||

<math> | <math> | ||

| Linia 85: | Linia 92: | ||

n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})=0 | n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})=0 | ||

</math> | </math> | ||

| + | |||

<math> | <math> | ||

\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}( | \underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}( | ||

\overline{x}_{i}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}n_{i}( | \overline{x}_{i}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}n_{i}( | ||

| − | \overline{x}_{i}-\overline{x}) | + | \overline{x}_{i}-\overline{x})^2 |

</math> | </math> | ||

| + | |||

| + | |||

<math> | <math> | ||

\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} | \underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} | ||

| − | (x_{ij}-\overline{x | + | (x_{ij}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}\underset{j=1 |

}{\overset{n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})^{2}+\underset{i=1}{ | }{\overset{n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})^{2}+\underset{i=1}{ | ||

\overset{k}{\sum }}n_{i}(\overline{x}_{i}-\overline{x} | \overset{k}{\sum }}n_{i}(\overline{x}_{i}-\overline{x} | ||

| − | ) | + | )^{2} |

</math> | </math> | ||

| + | |||

| + | |||

| + | |||

| + | |||

| + | inaczej | ||

| + | |||

| + | <math>\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} | ||

| + | (x_{ij}-\overline{x})^{2} = s_{wew}^{2}+s_{pom}^{2} | ||

| + | </math> | ||

| + | |||

Jeśli wszystkie pomiary pochodzą z tej samej populacji o wariancji | Jeśli wszystkie pomiary pochodzą z tej samej populacji o wariancji | ||

| Linia 104: | Linia 124: | ||

<math> | <math> | ||

| − | \frac{ | + | \frac{s^2_{wew}}{\sigma ^{2}}\ i\ \ \frac{s^2_{pom}}{\sigma ^{2}} |

</math> | </math> | ||

| Linia 111: | Linia 131: | ||

<math> | <math> | ||

| − | \frac{\left( n-k\right) | + | \frac{\left( n-k\right) s^2_{pom}}{\left( k-1\right) |

| − | + | s^2_{wew}} | |

</math> | </math> | ||

| Linia 132: | Linia 152: | ||

są nieobciążonymi estymatami wariancji populacji. | są nieobciążonymi estymatami wariancji populacji. | ||

| + | |||

| + | =Testy par a posteriori= | ||

| + | |||

| + | Testowanie ''a posteriori'' (inaczej ''post hoc'') -> [[WnioskowanieStatystyczne/Bonferroni | porównania wielokrotne]] | ||

Aktualna wersja na dzień 18:08, 5 maj 2024

Wnioskowanie_Statystyczne_-_wykład

Rozkład F

Niech zmienne [math]x[/math] i [math]y[/math] mają rozkłady [math]\chi ^{2}[/math] o odpowiednio [math]f_{1}[/math] i [math]f_{2}[/math] stopniach swobody. Zmienna

[math] F=\frac{\frac{1}{f_{1}} x}{\frac{1}{f_{2}}y}=\frac{f_{2}x}{f_{1}y} [/math]

posiada rozkład [math]F[/math] z [math]f_{1}[/math] i [math]f_{2}[/math] stopniami swobody o wartości oczekiwanej [math]E(f)=\frac{f_{2}}{(f_{2}-2)}[/math]

[math] f(F)=\left( \frac{f_{1}}{f_{2}}\right) ^{\frac{f_{1}}{2}}\frac{\Gamma \left( \frac{1}{2}\left( f_{1}+f_{2}\right) \right) }{\Gamma \left( \frac{f_{1}}{2} \right) \Gamma \left( \frac{f_{2}}{2}\right) }F^{\frac{f_{2}}{2}-1}\left( 1+ \frac{f_{1}}{f_{2}}F\right) ^{-\frac{f_{1}+f_{2}}{2}} [/math]

Dla próby z rozkładu normalnego wielkość

[math] \chi ^{2}=\underset{i=1}{\overset{N}{\sum }}\frac{(x_{i}-\overline{x})^{2}}{ \sigma ^{2}} [/math]

podlega rozkładowi [math]\chi ^{2}[/math] o [math]f=N-1[/math] stopniach swobody. Jeśli dwie takie próby zostały pobrane z jednej populacji, to iloraz

[math] F=\frac{\left( N_{y}-1\right) \underset{i=1}{\overset{N}{\sum (}}x_{i}- \overline{x})^{2}}{\left( N_{x}-1\right) \underset{i=1}{\overset{N}{\sum }} (y_{i}-\overline{y})^{2}} [/math]

podlega rozkładowi [math]F[/math] o [math]f_{y}[/math] i [math]f_{x}[/math] stopniach swobody.

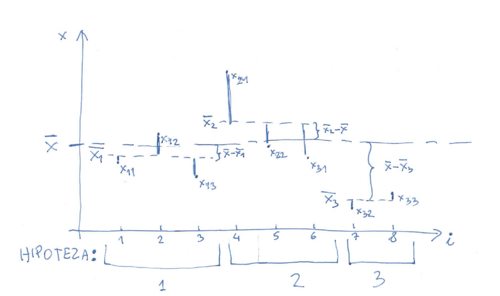

Analiza wariancji (ANalysis of VAriance — ANOVA)

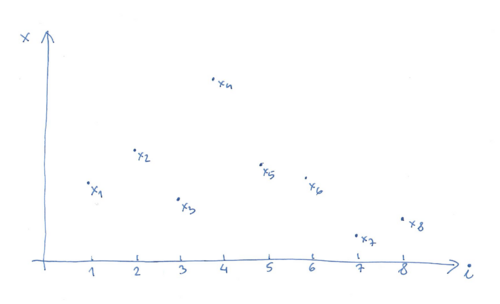

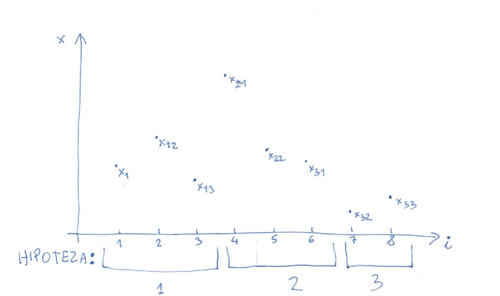

[math]N[/math] obserwacji [math]\{x_{i}\}_{i=1..N}[/math]

podzielonych na [math]k[/math] grup wedle jakiegoś kryterium: [math]N=n_{1}+n_{2}+...+n_{k}[/math].

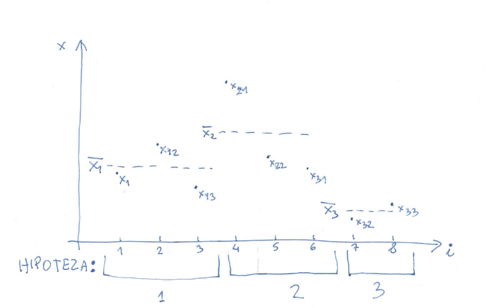

Średnie wewnątrz grup

[math] \overline{x}_{i}=\frac{1}{n_{i}}\underset{j=1}{\overset{n_{i}}{\sum }}x_{ij} [/math]

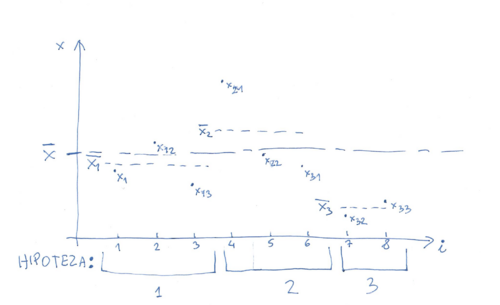

Średnia globalna [math]\overline{x}[/math]

Rozważmy sumę kwadratów odchyleń wszystkich elementów próby od wartości średniej całej próby:

[math]\begin{matrix}

\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}

(x_{ij}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{

\overset{n_{i}}{\sum }}(x_{ij}-\overline{x}_{i}+\overline{x}_{i}-\overline{x}

)^{2}=\\

=\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}

(x_{ij}-\overline{x}_{i})^{2}+\underset{i=1}{\overset{k}{\sum }}\underset{j=1

}{\overset{n_{i}}{\sum }}(\overline{x}_{i}-\overline{x})^{2}+2\underset{i=1}{

\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}(x_{ij}-\overline{x}

_{i})(\overline{x}_{i}-\overline{x})

\end{matrix}[/math]

[math] \underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} (x_{ij}-\overline{x}_{i})(\overline{x}_{i}-\overline{x})=\underset{i=1}{ \overset{k}{\sum }}(\overline{x}_{i}-\overline{x})\underset{j=1}{\overset{ n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})=0 [/math]

[math]

\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }}(

\overline{x}_{i}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}n_{i}(

\overline{x}_{i}-\overline{x})^2

[/math]

[math] \underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} (x_{ij}-\overline{x})^{2}=\underset{i=1}{\overset{k}{\sum }}\underset{j=1 }{\overset{n_{i}}{\sum }}(x_{ij}-\overline{x}_{i})^{2}+\underset{i=1}{ \overset{k}{\sum }}n_{i}(\overline{x}_{i}-\overline{x} )^{2} [/math]

inaczej

[math]\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i}}{\sum }} (x_{ij}-\overline{x})^{2} = s_{wew}^{2}+s_{pom}^{2} [/math]

Jeśli wszystkie pomiary pochodzą z tej samej populacji o wariancji

[math] \sigma ^{2}[/math], to

[math] \frac{s^2_{wew}}{\sigma ^{2}}\ i\ \ \frac{s^2_{pom}}{\sigma ^{2}} [/math]

podlegają rozkładom [math]\chi ^{2}[/math] o odpowiednio [math]n-k[/math] i [math]k-1[/math] stopniach swobody. Iloraz

[math] \frac{\left( n-k\right) s^2_{pom}}{\left( k-1\right) s^2_{wew}} [/math]

podlega rozkładowi [math]F[/math] o [math]k-1[/math] i [math]n-k[/math] stopniach swobody. Wyrażenia

[math] \frac{1}{n-k}\underset{i=1}{\overset{k}{\sum }}\underset{j=1}{\overset{n_{i} }{\sum }}(x_{ij}-\overline{x}_{i})^{2}\ oraz\ \ \frac{1}{k-1}\underset{i=1}{ \overset{k}{\sum }}n_{i}(\overline{x}_{i}-\overline{x})^{2} [/math]

czyli

[math] \frac{s_{wew}^{2}}{n-k}\ \ oraz\ \ \frac{s_{pom}^{2}}{k-1} [/math]

są nieobciążonymi estymatami wariancji populacji.

Testy par a posteriori

Testowanie a posteriori (inaczej post hoc) -> porównania wielokrotne