TI/LLM: Różnice pomiędzy wersjami

Z Brain-wiki

| Linia 11: | Linia 11: | ||

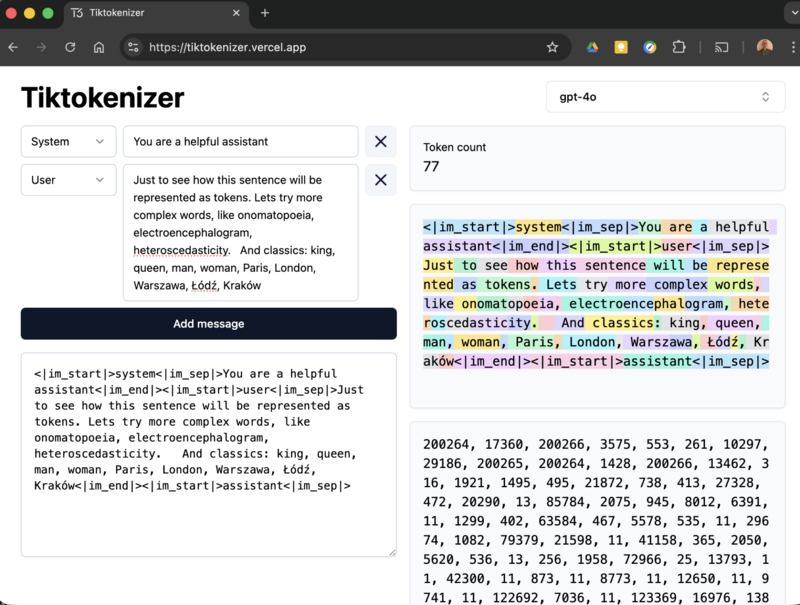

https://tiktokenizer.vercel.app/ | https://tiktokenizer.vercel.app/ | ||

[[Plik:Tiktokenizer.png|noborder|800px]] | [[Plik:Tiktokenizer.png|noborder|800px]] | ||

| + | |||

| + | |||

| + | |||

| + | ==Działanie== | ||

| + | https://poloclub.github.io/transformer-explainer/ | ||

Wersja z 11:23, 27 paź 2025

Spis treści

Duże modele językowe — Large language models, LLM

Na wykładzie o sztucznych sieciach neuronowych zapoznaliśmy się z procesem uczenia sieci. Uczenie i używanie dużych modeli językowych opiera się na tych samych podstawach, wprowadzając jednocześnie wiele nowości.

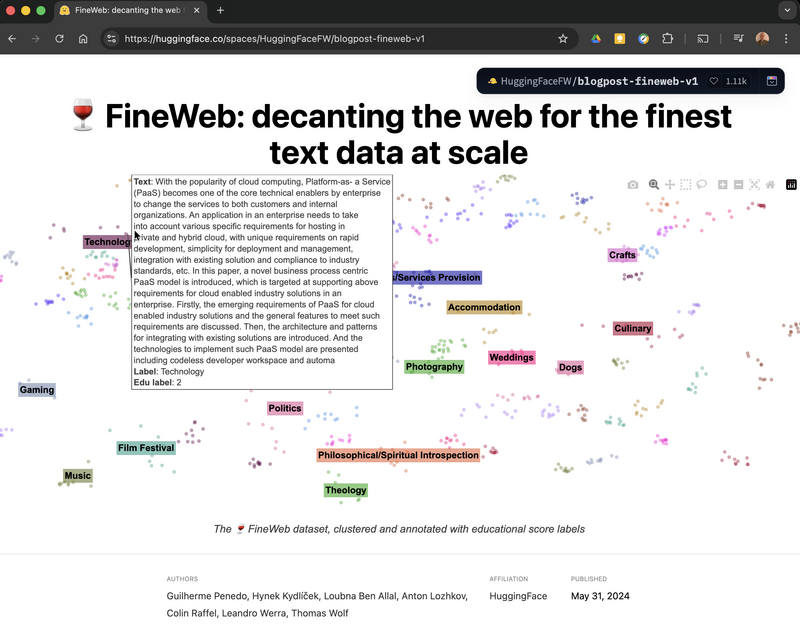

Korpus

https://huggingface.co/spaces/HuggingFaceFW/blogpost-fineweb-v1

Tokenizacja

https://tiktokenizer.vercel.app/