TI/Zera i jedynki: Różnice pomiędzy wersjami

| Linia 211: | Linia 211: | ||

W następnym rozdziale przyjrzymy się powstawaniu [[TI/Algorytm|programów komputerowych]]. | W następnym rozdziale przyjrzymy się powstawaniu [[TI/Algorytm|programów komputerowych]]. | ||

| + | |||

<div align="right"> | <div align="right"> | ||

[[TI/Cyfrowy_świat|⬅]] [["Technologia_informacyjna"|⬆]] [[TI/Algorytm|⮕]] | [[TI/Cyfrowy_świat|⬅]] [["Technologia_informacyjna"|⬆]] [[TI/Algorytm|⮕]] | ||

</div> | </div> | ||

Wersja z 07:18, 19 lip 2024

TI/ Zera i jedynki

W informatyce zdecydowanie króluje zapis dwójkowy (binarny). Można powiedzieć, że współczesne komputery "rozumują" w najprostszych z możliwych kategorii:

- namagnesowane/rozmagnesowane (fragment powierzchni dysku lub dyskietki),

- prąd płynie/nie płynie (we wnętrznościach komputera podczas pracy),

- światło odbija się lub nie (od powierzchni płyty CD-ROM).

Czyli ogólnie jest/nie ma, albo 1/0. Z pomocą jedynek i zer możemy zapisać dowolną liczbę naturalną, na przykład dodając jedynki i pomijając zera. Najefektywniejszym sposobem zapisu liczb naturalnych za pomocą zer i jedynek jest kod dwójkowy (inaczej binarny), czyli pozycyjny system liczbowy, w którym podstawą pozycji są kolejne potęgi liczby 2. Jak w każdym pozycyjnym systemie liczbowym, liczby zapisuje się tu jako ciąg cyfr, z których każda jest mnożnikiem kolejnej potęgi liczby stanowiącej podstawę systemu. Np. liczba zapisana w dziesiętnym systemie liczbowym jako 27, w systemie dwójkowym przybiera postać 11011, gdyż:

[math](11011)_2 = 1*2^4 1*2^3 + 0*2^2 + 1*2^1 + 1*2^0 = 16 + 8 + 0 + 2 + 1 = 27[/math]

Zapamiętajmy: liczba 27 nie jest zapisywana jako dwa znaki "dwa" i "siedem", tylko w postaci pięciu bitów, które wizualizujemy jako 11011, ale fizycznie zera i jedynki mogą odpowiadać np. różnym poziomom napięcia, namagnesowania czy odbijania światła.

Z przyczyn technicznych komputery operują na ciągach bitów o ściśle określonej długości, tzw. słowach maszynowych. Pierwsze popularne komputery były 8-bitowe, czyli długość słowa maszynowego w ich architekturze wynosiła 8 bitów, inaczej jeden bajt. Współczesne komputery używają słów 64-bitowych, czyli w naturalny sposób możemy w nich przechowywać i przesyłać np. liczby całkowite od zera do 264-1 = 18446744073709551615. Jeśli chcemy korzystać z liczb ujemnych, jeden bit musimy zarezerwować na znak, i dostajemy zakres od -263-1 do 263-1.

Zarezerwowanie na liczbę określonej liczby bitów może prowadzić do kłopotów, gdy np. w wyniku mnożenia dostaniemy liczbę spoza zarezerwowanego zakresu. Wtedy w programie może pojawić się błąd — na przykład możemy niechcący zmienić wartości następnych komórek pamięci w nieoczekiwany sposób. Na szczęście Python liczby całkowite zapisuje domyślnie w taki sposób, że ograniczeniem na ich wielkość jest tylko pojemność pamięci:

>>> pow(2,200) 1606938044258990275541962092341162602522202993782792835301376

Inaczej wygląda w języku Python zapis liczb rzeczywistych — reprezentowane są one jako liczby zmiennoprzecinkowe, których zakres i dokładność są stałe dla danej platformy i kompilatora. W Pythonie zakres liczb zmiennoprzecinkowych można sprawdzić następującą komendą:

>>> import sys; sys.float_info.max 1.7976931348623157e+308 >>> sys.float_info.min 2.2250738585072014e-308

W większości języków programowania deklarujemy zwykle na początku kodu, czy daną zmienną traktować jako liczbę całkowitą czy zmiennoprzecinkową (integer czy float). Python domyślnie "odgaduje" rodzaj zmiennej czy stałej na podstawie notacji; liczbie 2.71 przypisze typ float, a liczbie 3 — integer. Jeśli chcemy, żeby liczbę całkowitą interpreter potaktował jako zmiennoprzecinkową (z zerami po przecinku), wystarczy zamiast 3 napisać 3.0. Różnice podsumowuje poniższy przykład:

>>> pow(11, 500) 4969841967312266896286943165524556231604764697309876808312576299409619224420391617098708396225374948938868811371457556190750351283 7449875405039140440330009424543851341473661479835156198793475230001956315493079590327474913873798690064481533085354154735423096767 0270037410967840218444329890659363847179221191623190320315868031908010944057323402271016538750345991105598826076185532402126954259 73141414122679894203387024067292317607709706656265698204172143249895717068799024075072923130694160791083167647986127226561792230001 >>> pow(11.0, 500) Traceback (most recent call last): File "<stdin>", line 1, in <module> OverflowError: (34, 'Result too large')

ASCII i Unicode

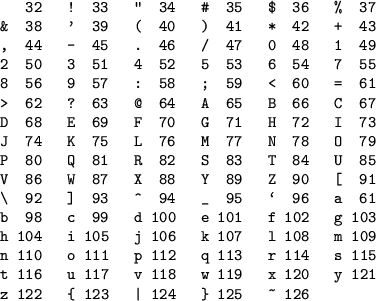

Żeby zapisywać cyfrowo teksty, trzeba po prostu ponumerować litery. Do niedawna standardem był ASCII (American Standard Code for Information Interchange), aktualnie rozszerzony do Unicode.

Jedna litera to w ASCII jeden bajt. Bajt to osiem bitów, czyli liczba między 0 a 255. Tablica ASCII (rys. 1) kończy się przed numerem 127. Za to brak tam ąćęłń... Nawet jeśli pominiemy pierwsze 32 znaki (są tam różne dziwne kody), pozostaje nam jeszcze druga połowa. Niestety, znaki wszystkich alfabetów narodowych nie zmieszczą się tam (tj. między 128 a 255) "za jednym razem". Dlatego dla różnych języków wprowadzano różne kodowania, czyli numeracje liter spoza ASCII. Dla języka polskiego obowiązującym w Internecie standardem jest (a w zasadzie można już powiedzieć, że był) ISO 8859-2. Zawiera on litery wystarczające do pisania (poza angielskim) w językach: Albanii, Bośni, Chorwacji, Czech, Finlandii, Węgier, Polski, Rumunii, Serbii, Słowacji i Słowenii. W tej sytuacji, aby prawidłowo wyświetlać tekst napisany w języku innym niż angielski, musieliśmy:

- wiedzieć, w jakim standardzie zakodowane są litery spoza ASCII,

- mieć czcionkę (font) z literami danego języka, umieszczonymi w odpowiednich miejscach.

Gdy nie był spełniony któryś z tych warunków, w miejsce polskich znaków diakrytycznych ąćęł... pojawiały się czasami dziwne "krzaczki", albo znaki z zupełnie innych alfabetów. Rozwiązaniem tego problemu jest standard UNICODE, który powstał pod koniec ubiegłego wieku. Zamiast jednego bajtu (ośmiu bitów), które w ASCII pozwalałay na zapis do 255 znaków, na tablicę wszystkich znaków znanych ludzkości przeznaczono cztery bajty (32 bity), co daje możliwość zapisu 4 294 967 296 znaków. Aby zmiejszyć objętość takiego zapisu stosuje się również bardziej skomplikowane sposoby zapisu, z różną liczbą bajtów w zależności od znaku. Np. w najpopularniejszym kodowaniu UTF-8 najpopularniejsze znaki (z ASCII) zajmują jeden bajt (czyli 8 bitów), a inne od 2 do 4 bajtów (czyli od 16 do 32 bitów).

Pliki tekstowe i binarne

Plik to ciąg zer i jedynek (bitów), za pomocą którego zapisano dowolną informację — na dysku, dyskietce, płycie CD-ROM czy taśmie. Warto sobie uświadomić ten fakt dokładnie: każdy plik jest nieprzerwanym ciągiem zer i jedynek i niczym więcej — bez odstępów, "opisów", ani żadnej dodatkowej informacji, która mówiłaby nam, jak dany plik odczytywać, interpretować i wyświetlać. Dlatego też, w celu poprawnego odczytania, musimy przynajmniej wiedzieć, z jakiego rodzaju plikiem mamy do czynienia.

Rozróżniamy przede wszystkim dwa rodzaje plików: tekstowe i binarne. Nazwy są trochę mylące, bo w pewnym sensie wszystkie pliki są binarne, czyli zapisane jako ciąg zer i jedynek. Jednak pliki tekstowe zajmują wśród nich wyróżnioną pozycję, gdzuyż sposób ich odczytywania jest najbardziej w świecie komputerów rozpowszechnionym standardem. Znajdują się w nich litery, zamienione na bity według przepisu z poprzedniego rozdziału. Zapisany w ten sposób plik można odczytać na dowolnym komputerze, niezależnie od systemu operacyjnego itp. W dodatku odczytać możemy tu rozumieć dosłownie, gdyż po zamianie bitów na litery (czyli wyświetleniu pliku ASCII) pojawia się tekst, zwykle zrozumiały dla człowieka. Może nie zawsze całkiem zrozumiały, ale przynajmniej powinniśmy zgadnąć, czy jest to sprawozdanie, list, tekst strony WWW czy kod źródłowy programu.

Ten sam ciąg bitów (plik) można interpretować na różne sposoby; na przykład 01000011010011110011111100111111 można odczytać jako:

| odczyt | interpretacja |

|---|---|

01000011010011110011111100111111

|

trzydzieści dwa bity |

0.747303187847137451

|

liczba rzeczywista (32-bitowa) |

67 79 63 63

|

cztery liczby całkowite (8-bitowe) |

C O ? ?

|

litery (ASCII) |

0100001101001111 0011111100111111

|

dwie „paczki" po szesnaście bitów |

20291 16191

|

dwie liczby całkowite (16-bitowe) |

Skoro z samych bitów trudno zgadnąć rodzaj pliku, pozostaje

wykorzystać do tego celu nazwę. Końcowa część nazwy pliku, tradycyjnie

oddzielana kropką, jest zwykle przeznaczona do określenia jego

typu. Na przykład w nazwie sprawozdanie_z_maja.txt człon

.txt, czyli rozszerzenie nazwy, oznacza typ pliku

(tekstowy, zwykle ASCII). Właściwa nazwa, która powinna kojarzyć się z

zawartością, to sprawozdanie_z_maja. Pliki z

rozszerzeniem txt określamy często jako

*.txt, gdzie * zastępuje dowolny ciąg

znaków.

Rozszerzenia plików mogą być przez system kojarzone z konkretnymi programami, zdolnymi do wyświetlania i/lub edycji plików danego formatu. Stąd często kliknięcie pliku, którego rozszerzenie jest przez system skojarzone z obsługującym ten typ programem, wystarcza do uruchomienia odpowiedniego programu i otwarcia pliku. Poniżej przytaczamy niektóre standardowe rozszerzenia nazw plików:

pliki tekstowe *.txt, *.asc obrazy *.jpg, *.jpeg, *.gif, *.bmp, *.pcx, *.png wideo *.mpg, *.mpeg, *.avi dźwięk *.mp3, *.wav, *.au, *.mid pliki TeX i LaTeX *.tex źródła programów *.c, *.pas, *.java... pliki WWW *.html, *.htm programy MS Windows *.exe Portable Document Format *.pdf archiwa skompresowanych plików *.zip, *.rar, *.arj, *.gz, *.tgz, *.Z, *.tar.Z pliki edytora tekstóm MS Word *.doc, *.docx MS Excel (arkusz kalkulacyjny) *.xls, *.xlsx

W następnym rozdziale przyjrzymy się powstawaniu programów komputerowych.